2024年7月12日,《欧盟官方公报》正式印发了具有里程碑意义的《欧洲人工智能法》的最终文本。

这项具有里程碑意义的立法包含180个序言、113条条款和13个附件,为欧盟境内人工智能系统的开发、部署和使用建立了全面的框架。该法将在公布20天后,即当地时间8月1日,北京时间8月2日正式生效,并在立法上采取了分阶段生效和基于风险的方法。2025年8月2日开始,通用人工智能模型(GPAI)相关规定开始生效,提供者将须履行透明度等义务。

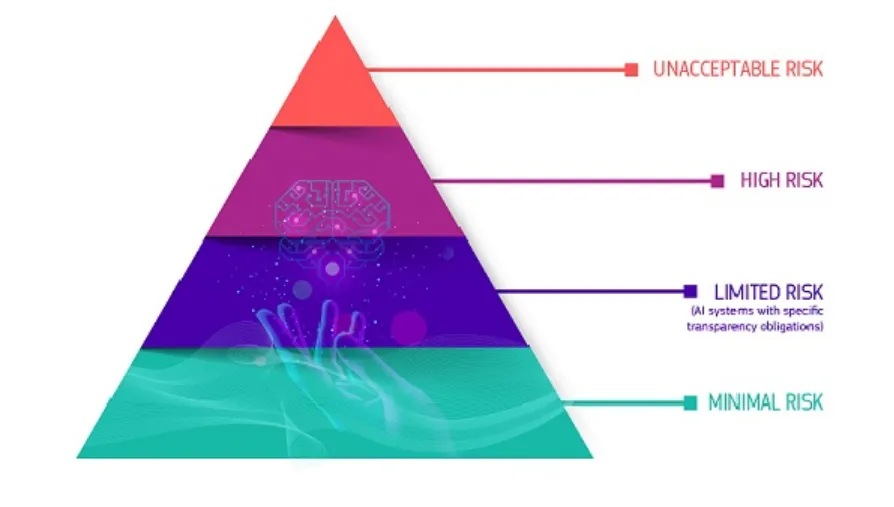

01|分阶段实施 (1)2024年11月2日之前,各成员国指定人工智能监管机构; (2)2025年2月2日开始,法案的一般规定和禁令规定将会生效,针对社会信用排名系统等具有“不可接受的风险”的人工智能的禁令清单开始适用,并将于法律颁布实施后的六个月内开始执行; (3)2025年5月2日之前,欧盟人工智能办公室将会发布行为准则; (4)2025年8月2日开始,通用人工智能模型(GPAI)相关规定开始生效,提供者将须履行透明度等义务; (5)2026年2月2日之前,欧盟委员会需要提出建立后市场监测计划模板,并列出计划所列要素清单; (6)2026年8月2日之前,法案将会全面生效,即法案内其他内容都将开始适用。包括附件三(高风险人工智能系统列表)中定义的高风险人工智能系统的全部义务。与治理和符合评估系统相关的基础设施应投入运行,成员国应在国家一级至少建立一个人工智能监管沙盒,该沙盒最迟应在2026年8月2日投入使用; (7)2027年8月2日之前,对于高风险人工智能系统相关的一些义务将开始适用。例如用于医疗设备、机械以及无线电设备的高风险人工智能系统。在2025年8月2日之前已投放市场的通用人工智能模型的提供者应采取必要步骤,以便在2027年8月2日之前遵守本条例规定的义务; (8)2028年11月之前,欧洲委员会应当就监管权力下放问题起草一份报告; (9)2030年12月31日之前,在2027年8月2日之前已经投放市场或投入使用的大型信息技术系统组成部分的人工智能系统应当符合本法规定。 02|基于风险的方法 欧盟人工智能法案采用基于风险的划分方法,根据人工智能系统对个人权利和安全的潜在影响将其分为四个层级。 (1)不可接受风险(Unacceptable Risk)。定义为对安全、生计和基本权利构成明显威胁的人工智能系统,根据法案第5条禁止。例如,社会评分系统、利用特定个人或者人群脆弱性的系统、使用超越人意识的潜意识系统、在公共空间使用实时远程生物识别系统、针对个人的预测性警务系统、工作场所和教育机构中的情绪识别系统。 (2)高风险(High Risk)。定义为可能危害安全、基本权利或导致重大不利影响的人工智能系统,受法案第6-51条规定的严格合规和透明度义务约束。例如,用于关键基础设施、教育、就业、基本服务、执法、移民管理和司法管理的人工智能等。判定高风险需要依据人工智能系统的功能、预期目的和行为方式。此类高风险人工智能系统的供应商必须运行合格评定程序,然后才能在欧盟销售和使用其产品。 (3)有限风险(Limited Risk)。定义为需要特定透明度措施的人工智能系统。例如,聊天机器人,情绪识别系统等。法案第52-54条概述的透明度义务。此类系统受信息和透明度要求的约束,生成或操纵图像、音频或视频内容(深度伪造)的人工智能系统的部署者必须披露该内容是人为生成或操纵的,特定情况除外(如被用于防止刑事犯罪时)。生成大量合成内容的人工智能系统提供商必须实施足够可靠、可互操作、有效和强大的技术和方法(如水印),以便能够标记和检测输出是由人工智能系统而不是人类生成或操纵的。 (4)最小风险(Minimal Risk)。定义为对公民权利或安全构成最小或无风险的人工智能应用。例如,人工智能支持的视频游戏,垃圾邮件过滤器等。除现有法律外,无额外法律要求。根据欧盟委员会的说法,目前在欧盟使用或可能在欧盟使用的绝大多数人工智能系统都属于低风险系统。

概述

欧盟人工智能法案(EU Artificial Intelligence Act)是全球首部针对人工智能的全面立法,旨在建立一套统一的规范和监管框架,以确保人工智能技术的发展和应用能够遵循公平、透明和可信的原则。

核心内容

法案将人工智能系统根据其潜在风险等级划分为四类:

不可接受风险:严重威胁人身安全或基本权利的系统,如社会评分系统,将被完全禁止。

高风险:可能对人身安全、健康、环境或基本权利造成重大风险的系统,如无人驾驶汽车、医疗诊断软件等,需满足严格的安全和透明度要求。

有限风险:可能对人身安全、健康或环境造成轻微风险的系统,如聊天机器人、语音助手等,需遵守透明度义务。

低风险:基本不会对人身安全、健康或环境造成风险的系统,如垃圾邮件过滤器、拼写检查器等,可自由使用。

主要规定

对高风险人工智能系统的严格监管:

需经过合格的第三方机构进行一致性评估,并获得欧盟委员会颁发的CE认证。

需遵守详细的透明度义务,包括公开其功能、数据来源和算法等信息。

需建立有效的风险管理体系,并定期进行安全测试和漏洞评估。

对人工智能系统的透明度要求:

用户有权知晓其是否与人工智能系统互动,并获得有关该系统如何运作的信息。

人工智能系统产生的结果应以清晰、透明的方式呈现,并告知用户该结果是由人工智能系统生成的。

禁止使用歧视性人工智能系统:

禁止基于种族、宗教、性别、性取向、政治观点等因素设计或使用人工智能系统。

人工智能系统应经过测试,以确保其不会产生歧视性结果。

影响

欧盟人工智能法案的颁布将对全球人工智能产业产生深远影响,主要体现在以下几个方面:

促进以人为本的人工智能发展:法案将推动人工智能技术的研发和应用更加注重人权、伦理和社会责任,促进以人为本的人工智能发展。

提升人工智能系统的安全性和可信度:法案对高风险人工智能系统的严格监管将提升其安全性和可信度,降低其潜在风险。

推动人工智能产业创新:法案将为人工智能产业发展提供更加清晰的法律框架,促进人工智能产业创新升级。