每个企业都需要数据战略,该战略明确定义安全、可靠地管理其数据(信息)资产和实践所需的技术、流程、人员和规则。强大、领先的数据战略是企业长期成功的基础。结合当下正在发生的变化,建议CIO们从7个方面更新数据战略思维。

与IT中的几乎所有内容一样,数据战略必须随着时间的推移而发展,以跟上不断发展的技术、客户、市场、业务需求和实践、法规以及几乎无穷无尽的其他优先事项。

以下是七个主要趋势的简述,这些趋势可能会在未来重塑您组织的当前数据战略。

1.实时数据变得实时-处理数据的复杂性也变得实时

业务咨询公司Accenture(埃森哲)的全球数据和人工智能主管Lan Guan(观澜)建议,首席信息官应优先考虑其投资战略,以应对涌入企业日益增长的复杂实时数据。

Lan Guan认为,在当今的商业环境中,拥有开发利用数据的能力是组织的优势,“从组织数据中获得的独特洞察构成了其业务特有的竞争优势,不易被竞争对手复制,”她观察到,“如果不能满足这些需求就意味着组织将被抛在后面,将错过数据分析进步带来的许多机会。”

Lan Guan说,每个组织的数据战略的下一步应该是投资并利用人工智能和机器学习,从而从数据中释放更多价值。“成功的数据策略与有效的人工智能部署相结合,带来了许多机会,其中包括机器自动预测、维护或通过运营数据优化劳动力效率等举措。”

2.内部数据访问需求占据中心地位

首席信息官们和数据领导者们对内部数据访问的需求越来越大。IBM Data的人工智能和自动化总经理Dinesh Nirmal(迪内希·尼马尔)表示:“数据不再只是分析师和数据科学家使用的。他们组织中的每个人——从销售到营销,从人力资源到运营——都需要访问数据从而做出更好的决策。”

缺点是,提供及时、有效的相关数据使便捷访问变得越来越具有挑战性。Nirmal(尼马尔)表示:“尽管进行了大量投资,由于分布在多个云、应用程序、位置、环境和供应商之间,企业内部的数据环境仍然过于复杂。”。

因此,越来越多的IT领导者正在寻找数据策略,使他们能够管理位于数据中心的大量不同数据,而不会带来新风险或是涉及违规、违法。Nirmal(尼马尔)表示:“尽管内部对数据访问的需求不断增加,但(首席信息官)也必须跟上快速发展的监管和合规措施的步伐,如《欧盟人工智能法案》(见注1)和新发布的《白宫人工智能权利法案蓝图》(见注2)。”

3.外部数据共享具有战略意义

商业咨询公司Deloitte Consulting(德勤咨询公司)首席未来学家Mike Bechtel(迈克·贝克特尔)观察到,商业伙伴之间的数据共享变得更加容易,也更加趋向合作。他说:“随着云原生数据仓库和相邻数据洞察平台的大量采用,我们开始看到有趣的使用案例,企业能够将其数据与交易对手的数据结合起来,从而创建全新的、可销售的数字资产”。

Bechtel(贝克特尔)预计外部数据共享将发生巨大变化。他说:“多年来,董事会和服务器机房人员都在抽象地谈论拥有所有这些数据的价值,但我们中的geeks(极客们)已经知道,要想将这些数据货币化,就必须使其更具流动性。公司可能拥有数PB(计算机存储容量单位,1PB=1024TB==2^50字节。)的有趣数据,但如果这些数据在老化的内部仓库中沉睡,你将无法利用这些数据。”

4.数据结构和数据网格采用率上升

数据结构和数据网格技术可以帮助组织以实用的方式从技术堆栈和层次结构中的所有元素中获取最大价值。IT咨询机构Resultant的首席顾问Paola Saibene(保拉·萨伊贝内)表示:“许多企业仍然使用传统解决方案、新旧技术、传承的政策、流程、程序或方法,但不得不将所有这些都融入一个新的架构中,从而提高灵活性和速度。”

网状结构使组织能够从当前状态的环境中获取所需的信息和见解,而不必对其进行根本性的改变或大规模的破坏。“这样,首席信息官可以利用他们已经拥有的‘工具’,但在其上再加上一层,从而使他们能够以现代和快速的方式利用所有这些资产。”Saibene(萨伊贝内)解释道。

数据结构是一种通过使用智能和自动化系统实现各种数据管道和云环境端到端集成的架构。Saibene(萨伊贝内)指出,结构,特别是在活动元数据级别的结构,是非常重要的。她说:“互操作性代理会让一切看起来都是非常好的连接,而且是有意设计的。因此,您可以获得所有需要的见解,同时避免需要对环境进行全面检查。”

5.数据可观察性成为业务关键

数据可观测性通过密切监视数据流入和流出应用程序,扩展了数据质量的概念。数据可观测性提供商Kensu的创始人、《数据可观测基础》(Fundamentals of data observability,O’Reilly,2022)的作者Andy Petrella(安迪·佩特雷拉)表示,该方法提供了对应用程序信息、模式、度量和谱系的业务关键见解。

一个关键的数据可观察性属性是它作用于元数据,提供了一种直接监视应用程序中数据的安全方法。当敏感数据离开数据管道时,Petrella(佩特雷拉)说,它由数据可观测性代理收集。他补充道:“有了这些信息,数据团队可以更快地解决数据问题,防止数据(未经授权)传播,降低维护成本,恢复对数据的信任,并扩大数据的价值创造。”

Petrella(佩特雷拉)声称,数据可观测性创造了一个全新的解决方案类别。他指出:“首席信息官首先应该了解观察数据的不同方法,以及数据与质量管理的区别。”然后,他们应该确定数据团队中的利益相关者,因为他们将负责采用可观测性技术。

无法提高数据质量可能会阻碍数据团队的工作效率,同时降低整个数据链的数据信任度。Petrella(佩特雷拉)表示:“从长远来看,这可能会将数据活动推到后台,影响组织的竞争力,最终影响其收入。”。

Cisco AppDynamics(思科,是全球领先的网络解决方案供应商。)首席技术官Gregg Ostrowski(格雷格·奥斯特洛夫斯基)观察到,IT领导者正在应对技术堆栈中不断增长的复杂性和难以理解的数据量。他指出:“他们必须将大量扩展的云原生服务与现有的内部部署技术相集成。从数据战略的角度来看,最大的趋势是IT团队需要在其应用程序中获得清晰的可视化和洞察力,无论是在本地、云环境还是混合环境中。”

6.“数据即产品”开始提供业务价值

数据即产品是一个概念,旨在通过使用从许多不同来源捕获的混合数据来解决现实世界的业务问题。全球工程、采购、咨询和建筑公司Black&Veatch(博莱克威奇国际公司)首席信息官Irvin Bishop,Jr.(小欧文·毕晓普)说道。

Bishop(毕晓普)表示,了解如何获取和应用数据可以在许多方面力挽狂澜。他报告称,Black&Veatch(博莱克威奇国际公司)正在与客户合作开发数据产品路线图并建立相关KPI。“一个例子是我们如何利用水行业的数据来更好地管理关键基础设施的物理健康,”他指出。“数据使我们的水务客户能够根据过去的性能数据预测何时可能需要更换设备,以及设备能够承受何种类型的环境影响。”Bishop(毕晓普)表示,该方法使参与的客户能够更好地控制服务可靠性和预算。

7.出现跨职能数据产品团队

商业咨询公司EY Americas的数据和分析负责人Traci Gusher(特拉齐·古谢尔)表示,随着企业开始将数据视为一种产品,建立跨IT、业务和数据科学部门的产品团队变得非常必要。

Gusher(古谢尔)表指出,数据收集和管理不应仅仅被归类为另一个项目。她声称:“数据需要被视为一个功能齐全的业务领域,与人力资源或财务没有区别。转向数据产品方法意味着您的数据将被视为与物理产品一样的产品-开发、营销、质量控制、优化改进,并具有明确的追溯价值。”

John Edwards(约翰·爱德华兹)

撰稿人,首席信息官

注1:《欧盟人工智能法案》(EU Artificial Intelligence Act)

欧盟人工智能法案将于2024年强制执行,留给中国人工智能相关企业的时间已经不多。

2021年4月,欧盟委员会发布了欧洲议事和理事会《关于制定人工智能统一规则》的提案(以下简称“草案”)。在草案中,欧盟针对人工智能的监管提出了四种政策选项供利益相关方讨论,分别为:

选项1:欧盟自愿贴标体系(EU voluntary labelling scheme)

建立一个欧盟统一的自愿性贴标体系,无论AI的风险高低,由提供商自愿选择是否进行认证贴标。自愿参与贴标体系的AI提供商需要对其AI进行自评估,由欧盟各成员国各自的授权机构在投入市场应用前进行检查其符合性,并在投放市场之后进行监督。

此选项对AI的要求仅会限制在以下几个方面中的最低限度要求:

a, 数据管理和数据质量;Data governance and Data quality

b, 可追溯性和文件管理;Traceability and Documentation

c, 算法透明度和信息提供(给用户);Algorithmic transparency and Provision of information

d, 人类监督;Human oversight

e, 准确性、鲁棒性和信息安全。Accuracy, Robustness and Security

选项1要求建立欧盟合作的轻机制,即建立成员国授权机构之间信息交换与统一执行尺度的机制。

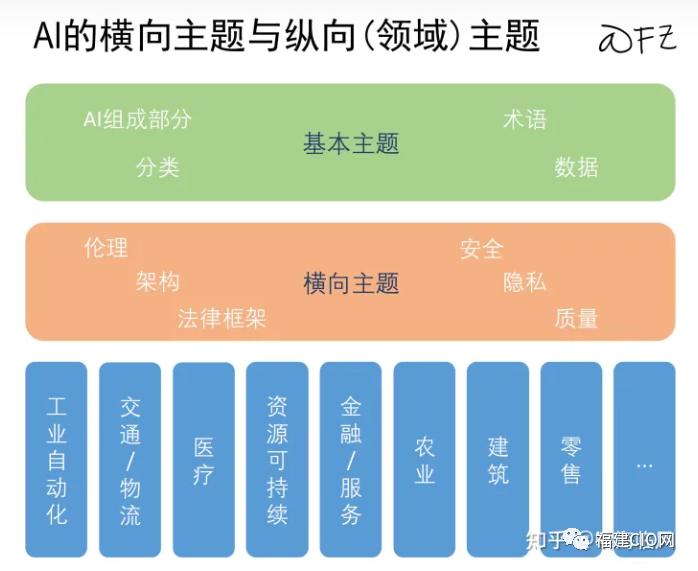

选项2:分领域制定特定方案 (A sectoral, ‘ad-hoc’ approach)

为AI的每个特定领域量身设定不同的法案,施加对象为特定AI应用的提供商及用户,如远程生物识别,深度造假(Deepfake),用于招聘的系统应用,聊天机器人,和一些应被禁止的特定应用等。此选项旨在为不同领域的AI,基于其不同的使用环境,分别建立纵向的不同法规要求,而非横向且统一的法规要求。因此也不会有共同的监管框架,相同的执行机制,或国家授权机构间的合作平台。

具体要求分为三个方面:

a, 在特定领域对AI提供商和用户的要求和义务,类似选项1中的要求并加上每个特定用例的附加要求以及对用户的义务要求;

b, 公共场所的远程生物识别应用的额外保障措施,仅为特定紧急且受到监管的案例提供许可;

c, 禁止一些有害的AI应用,包括具有操纵性和剥削性的AI系统,和对自然人的社会打分。

选项2的执行机制依赖于各特定领域的法案,其执行机制可能会有很大差异,这可能会造成领域之间的隔离。

图一,AI的横向主题与纵向(领域)主题

选项3:横向的欧盟法案,对高风险AI强制性评估(Horizontal EU legislative instrument establishing mandatory requirements for high-risk AI applications)

基于风险评估,对于所有高风险AI要求进行强制性评估,并禁止AI在一些特定危险领域的应用。

具体要求会分为四个方面:

a, 禁止AI应用在公共区域的远程生物识别,并增加额外保障措施(如选项二中b & c部分);

b, 识别高风险AI系统的统一方法;

c, 对高风险AI系统的横向强制性要求,和对提供商及用户的义务;

d, 对非高风险AI系统的最低透明度要求。

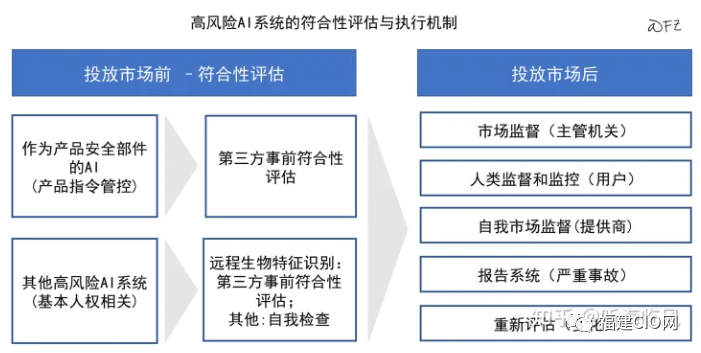

选项3的执行需要建立一套跨领域的通用监管与执行机制,辅以支持AI创新的特殊措施。执行机制又有三种选项:事后(ex post)追溯系统,事前(ex ante)系统及两者结合的系统(ex post + ex ante)。

- 事后追溯系统由各成员国的授权机构执行市场监督,调查已投入市场的高风险AI系统的符合性,对不符合的AI系统进行罚款,要求AI相关方采取补救措施,并记入欧盟现有的不符合产品登记系统(RAPEX系统)。

- 事前系统强制要求高风险AI满足欧盟自由市场法律架构(NLF)。经相关评估满足法令的AI系统将记录一个独立的AI产品登记系统。事前系统可以按AI的风险类型与现有产品安全的指令结合,根据各指令的要求可能是自己检查或第三方评估。法令的符合性应依据欧盟标准化组织采纳的协调标准(Harmonized standard)

图二,高风险AI系统的符合性评估与执行机制

选项3+:对高风险AI强制性评估 + 非高风险AI的自愿行为准测 (Horizontal EU legislative instrument establishing mandatory requirements for high-risk AI applications + voluntary codes of conduct for non-high risk applications)

在采用选项3对高风险AI应用的强制性要求与义务的同时,欧盟委员会鼓励行业协会和其他代表组织采用自愿性的行为准则,促使所有非高风险应用的提供商自愿遵守可信赖AI的要求与义务。自愿行为准则建立在自我监管的基础上,仅规定了可信赖AI对低风险AI系统的最低要求。与选项1不同的是,选项3+并不建议对非高风险AI实施自愿性认证和贴标。

选项4:横向的欧盟法案,对所有AI强制性评估(Horizontal EU legislative instrument establishing mandatory requirements for all AI applications, irrespective of the risk they pose)

对AI系统的提供商和用户施加相同于选项3的要求与义务。但不同的是,此选项将适用于所有AI系统,不对AI系统做风险评估分类,无论AI的风险高低都将对其进行强制性评估要求。

注2:美国《人工智能权利法案蓝图》(Blueprint for an AI Bill of Right)

2022年10月4日,白宫科技政策办公室(OSTP)发布《人工智能权利法案蓝图》(Blueprint for an AI Bill of Right),反映了拜登政府对私营公司和政府机构鼓励采用人工智能(AI)技术的原则设想,以减轻涉及数据隐私、算法歧视和自动化系统使用的风险。

该蓝图确定了五项原则,用以指导自动化系统的设计、使用和部署,以保护人工智能时代美国公众的利益。这些原则是通过与美国公众的广泛协商制定的,是建立和部署符合民主价值、保护公民权利、公民自由和隐私的自动化系统的蓝图。五项原则包括:

(1)建立安全和有效的系统;

(2)避免算法歧视,以公平的方式使用和设计系统;

(3)保护数据隐私;

(4)系统的通知和解释要清晰、及时和可访问;

(5)设计自动系统失败时使用的替代方案、考虑因素和退出机制。

《人工智能权利法案蓝图》的原则和相关做法形成了一套相互交叉、防止潜在不利的应对措施,为将这些保护措施纳入政策、实践或技术设计过程提供参考。