研究人员发现,在医学测试中,Llama 2(2023年7月19日,Meta AI已正式发布最新一代开源大模型。训练所用的token翻了一倍至2万亿,同时对于使用大模型最重要的上下文长度限制,Llama 2也翻了一倍。Llama 2包含了70亿、130亿和700亿参数的模型。Meta宣布将与微软Azure进行合作,向其全球开发者提供基于Llama 2模型的云服务。同时Meta还将联手高通,让Llama 2能够在高通芯片上运行。)的表现并不比随机瞎猜好多少,而GPT-4(OpenAI为聊天机器人ChatGPT发布的语言模型)能够获得及格分数。

图源:magicmine / Getty Images

图源:magicmine / Getty Images

生成式人工智能(AI)中最热门的争论之一是开源与闭源:哪一个更有价值?

一方面,以迄今为止最负盛名的开源模型Meta的Llama 2为首,不断发展的贡献者群体不断产生大量开源大型语言模型(LLM)。代表闭源LLM的则是两个最成熟的商业程序,OpenAI的GPT-4和风险投资支持的初创公司Anthropic(是一家人工智能初创公司,由前 OpenAI 员工创立,成立于2021年,总部位于旧金山,致力于构建可靠、可解释和可控的人工智能系统)的语言模型,即Claude 2(Anthropic发布的全新的 Claude 2 大语言模型。相比前代版本,Claude 2 性能有所提升,支持上传文件,且能够实现更长文本的响应,在编程、数学、推理等方面都有大幅提升。)

相互测试这些程序的一种方法是看看它们在回答特定领域的问题时表现如何,例如医学知识。

根据Pepperdine University(佩珀代因大学,简称PPD,是一所美国加州一流的私立研究型大学,于1937年由基督教商人乔治·佩珀代因创办,其位于加州马里布的校园是全美最美丽的大学校园之一。)、University of California at Los Angeles(加利福尼亚大学洛杉矶分校,简称:UCLA,是位于美国洛杉矶的公立研究型大学,是环太平洋大学联盟和国际公立大学论坛成员,被誉为“公立常春藤”,入选英国政府“高潜力人才签证计划”。)和UC Riverside(加利福尼亚大学河滨分校,简称UC Riverside或UCR,是一所公立综合性研究型大学,美国大学协会AAU成员,被誉为公立常春藤,环太平洋大学联盟和国际公立大学论坛成员。是世界上最具影响力的公立大学系统之一,加州大学系统中十所学校之一,也是该系统中发展最快的一所大学。该校非常重视科研,拥有加州大学傲人的学术传统。)的科学家们最近发表的一项研究,在此基础上,Llama 2在回答肾脏学领域的问题方面表现不佳。该研究本周发表在著名的New England Journal of Medicine(《新英格兰医学杂志》,简称NEJM。是由美国麻州医学协会/Massachusetts Medical Society所出版的评审性质医学期刊/medical journal和综合性医学期刊,创刊于1812年。是全球影响因子最高的医学学术期刊,影响因子大概为70。)出版的新子刊《NEJM AI/新英格兰人工智能》上。

“与GPT-4和Claude2相比,开源模型在总体正确答案和解释质量方面表现得不佳,”Pepperdine(佩珀代因大学)的Keck数据科学研究所的首席作者Sean Wu(肖恩·吴)和同事写道。

Scholars at Pepperdine University converted nephrology questions into prompts to feed into a bunch of large language models, including Llama 2 and GPT-4.

New England Journal of Medicine

他们写道:“GPT-4的表现异常出色,在大多数主题上都取得了类似人类的表现。”得分为73.3%的分数,略低于75%的分数,这一分数是必须回答多项选择题肾脏学问题的人员的及格分数。

他们写道:“大多数开源LLM(大型语言模型)的总体得分与随机回答问题时的预期没有区别。”Llama 2在包括Vicuña(受 Meta LLaMA 和 Stanford Alpaca 项目的启发,来自加州大学伯克利分校、CMU、斯坦福大学和加州大学圣地亚哥分校的成员,共同推出了一个 Vicuna-13B 开源聊天机器人,由增强的数据集和易于使用、可扩展的基础设施支持。)和Falcon(阿联酋的TII/技术创新研究所开发的「Falcon」猎鹰是一款开源语言模型,目前该模型已经发布了三个版本——1B、7B和40B,其中最大的版本,Falcon40B,拥有400亿参数,是目前全球最强大的开源语言模型之一。)在内的5个开源模型中表现最好。Llama 2程序仅略高于随机猜测的水平(23.8%),得分为30.6%。

这项研究是对人工智能中所谓的“zero-shot”(零次学习。是指在训练阶段不存在与测试阶段完全相同的类别,但是模型可以使用训练过的知识来推广到测试集中的新类别上。)任务的测试,其中使用的语言模型没有修改,也没有正确答案和错误答案的例子。零次学习是一种测试“上下文学习”的方法,上下文学习是语言模型获取训练数据中没有的新能力。

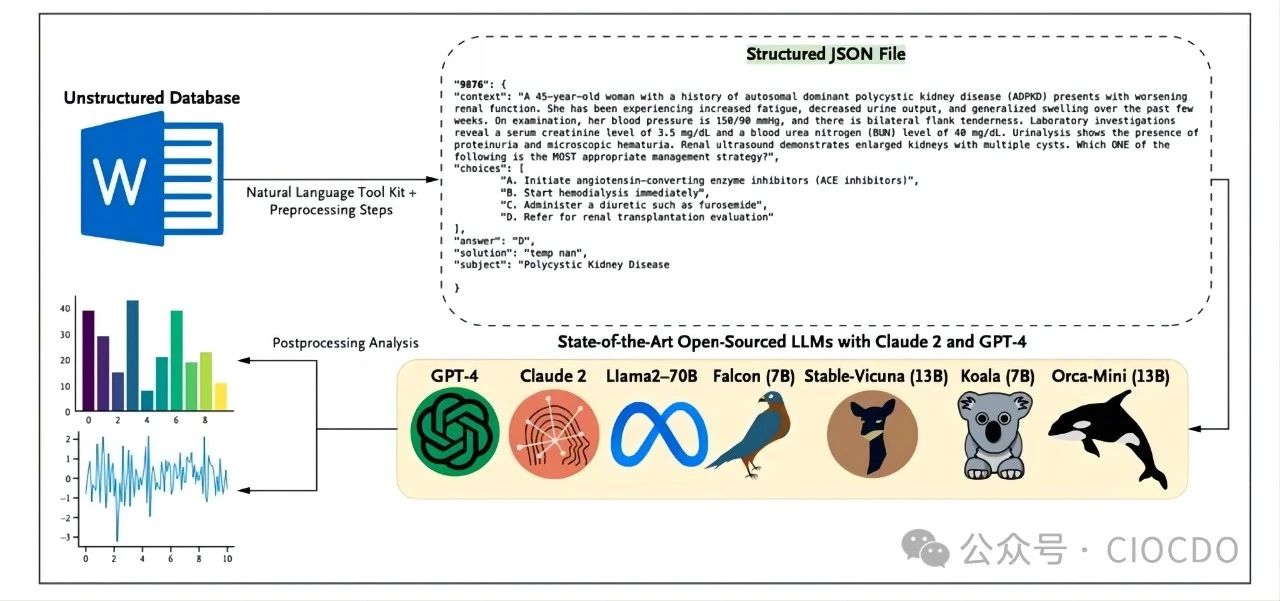

在测试中,模型——Llama 2和其他4个开源程序,以及两个商业程序——分别收到了NephSAP/Nephrology Self-Assessment Program(肾病自我评估计划,为医生提供了一个学习平台,科学家,高级执业医师,护士,药剂师,和其他卫生专业人员的工作和培训领域的肾脏更新和刷新他们的临床知识,诊断和治疗技能。)的858个肾脏科领域问题,NephSAP是American Society of Nephrology(美国肾脏病学会,成立于1966年,是世界上最大的致力于肾脏疾病研究的专业学会,在全球132个国家/地区拥有21240余名成员。ASN愿景是预防、治疗和治愈肾脏疾病。)的一份出版物,用于该领域的医生自学。

作者必须进行重要的数据准备,以将NephSAP(肾病自我评估计划)的纯文本文件转换为可以输入到语言模型中的提示。每个提示中都包含了自然语言中的问题和多项选择题的答案。该数据集已发布,供其他人在HuggingFace(起初是一家总部位于纽约的聊天机器人初创服务商,本来打算创业做聊天机器人,然后在github上开源了一个Transformers库,虽然聊天机器人业务没搞起来,但是他们的这个库在机器学习社区迅速大火起来。目前已经共享了超100,000个预训练模型,10,000个数据集,变成了机器学习界的github。)上使用。

由于GPT-4和Llama 2等在许多情况下都会产生冗长的文本输出作为答案,作者还必须开发自动技术来解析每个模型的答案,然后比较模型的答案自动得分的结果。

与GPT-4相比,开源模型表现不佳有很多潜在的原因,但作者怀疑一个重要的原因是Anthropic和OpenAI在其程序培训中加入了专有医疗数据。

他们写道:“GPT-4和Claude 2不仅接受了公开数据的培训,还接受了第三方数据的培训。”

“在医学领域培训LLM(大型语言模型)的高质量数据通常存在于经过整理和同行评审的非公共材料中,如教科书、已发表的文章和经过整理的数据集。”Wu(吴)和其团队指出,“在不否定特定LLM计算能力重要性的情况下,访问目前不在公共领域的医学训练数据材料的能力可能仍然是决定未来特定LLM性能是否会提高的关键因素。”

显然,随着GPT-4的得分比人类及格分数低两分,所有语言模型都有很大的改进空间,而不仅仅是开源。

令开源人群感到高兴的是,各界目前正在努力提高训练数据的胜算。

其中一项努力是广泛开展所谓的联合训练,即在私有数据上本地训练语言模型,然后将训练结果贡献给公共云中的综合努力。

这种方法可以成为弥合医学领域机密数据源和加强开源基础模型的集体努力之间的分歧。这一领域的一项突出努力是ML Commons(是一个将全球企业、组织、学界联合起来的非营利组织,期望通过将各界资料汇集、创建可以用于AI数据训练的公共数据库,以加速整个机器学习产业的发展。旨在帮助AI与机器学习模型的进一步发展,通过提供数据数据库、模型、准则与指标的方式,帮助计算机视觉、自然语言过程、语音识别等机器学习应用,借由数据的集成增加应用场景,并凝聚共同的力量来加速开发过程。前身是MLPerf。MLPerf是一间成立于2018年的产业基准组织,集结了英特尔、NVIDIA、Facebook AI、Google、亚马逊、阿里巴巴和百度、微软、哈佛大学、斯坦福大学等产、学机构的参与,制定了机器学习性能的通用标准测试工具,用于帮助加速开发、创造更多样的AI产品。)行业联盟去年开始的MedPerf(IHU Strasbourg、丹娜法伯癌症研究所/Dana-Farber Cancer Institute、Intel 等多个机构组成的研究团队联合推出用于在医疗领域对 AI 模型进行基准测试的开放平台。MedPerf 专注于通过将 AI 模型安全地分发到不同的机构,例如医疗机构,来实现 AI 模型的联合评估。将模型引入数据的过程使每个设施能够在高效且人工监督的过程中评估和验证人工智能模型的性能,同时优先考虑隐私。)努力。

一些商业模式也有可能被提炼成开源程序,从上一代那里继承特定的医疗能力。例如,谷歌DeepMind(位于英国伦敦,是由人工智能程序师兼神经科学家Demis Hassabis等人联合创立的Google旗下前沿人工智能企业。其将机器学习和系统神经科学的最先进技术结合起来,建立强大的通用学习算法。最初成果主要应用于模拟、电子商务、游戏开发等商业领域。)的MedPaLM是一个LLM(大型语言模型),它可以回答来自各种医疗数据集的问题,甚至还包括谷歌发明的一种全新的代表消费者在互联网上提出的关于健康的问题的。

即使没有对程序进行医学知识方面的培训,也可以通过“检索增强生成”来提高输出,这是一种LLM(大型语言模型)在形成输出时寻求外部输入的方法,以放大神经网络本身的功能。

无论哪种方式表现更佳,但此时Llama2和其他模型的开放性为多方提供了使程序改进的机会,而不像GPT-4和Claude 2这样的商业项目,它们的运营由其公司所有者自行决定。

作者:Tiernan Ray(蒂尔南·雷)